Reconnaissance faciale : Une technologie d’avenir déjà là

La reconnaissance faciale se développe et s’installe en France. Trop lentement, selon des élus et industriels soucieux de faire de cette technologie un fleuron tricolore. Les réglementations européennes ne sont plus vues comme des garanties, mais comme des obstacles. Solution toute trouvée : expérimenter d’abord, discuter ensuite… En marche vers l’inéluctable.

dans l’hebdo N° 1586 Acheter ce numéro

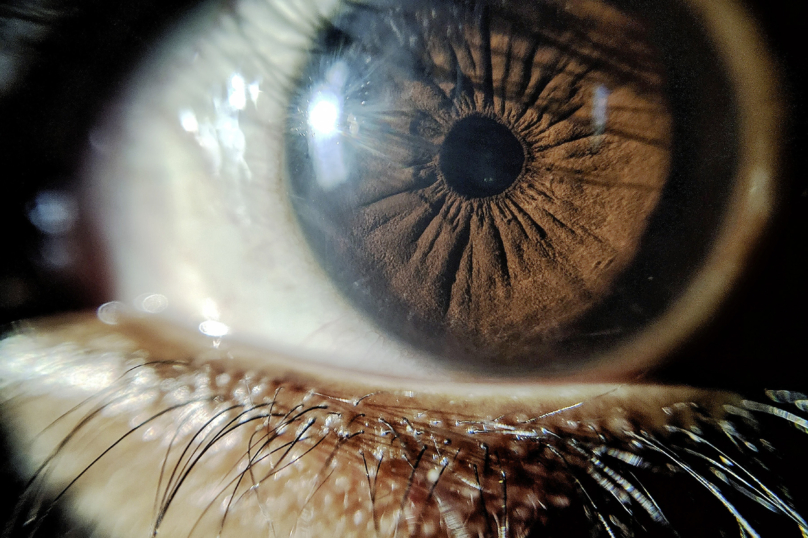

La reconnaissance faciale fait cette promesse. Celle de ne plus laisser à l’homme seul la capacité de reconnaître ou d’identifier une personne. Il faut l’imaginer sur une photo de foule : là où un humain doit se concentrer sur un visage avant de passer à un autre, la machine réalise un focus multiple, systématique, permanent. La technologie s’emploie déjà en France, du déverrouillage d’un téléphone à la recherche d’un suspect lors d’une enquête judiciaire. Mais de manière trop limitée pour des élus aux discours sécuritaires, des forces de l’ordre conquises par cet œil si parfait et des industriels soucieux de s’ouvrir un nouveau marché. Il manquerait un cadre pour passer à la vitesse supérieure. Cédric O veut franchir le pas. La France va se lancer dans une expérimentation en la matière, annonçait le secrétaire d’État chargé du numérique au Parisien, le 24 décembre. Après une phase de test de six mois à un an, suivra un débat public. La méthode paraît douce à s’y méprendre. Mais, derrière ces précautions, tout concourt à une installation ferme et durable de la reconnaissance faciale en France.

Longtemps chimérique, cette performance technologique tend à se parfaire par les progrès réalisés en deep learning (1), avec les réseaux de neurones artificiels. Ce système simule l’architecture du cerveau humain, mais avec la puissance de calcul d’un ordinateur. Ces réseaux doivent se nourrir d’un grand nombre de données, des photos d’humains et de chats, par exemple, pour apprendre à les distinguer. Une fois qu’elle l’a reconnu, la machine appose une série de points sur le visage et ses traits caractéristiques. Distance entre les pupilles, forme de la bouche ou du nez… La machine peut alors individualiser une personne, la rendre unique, et donc la singulariser parmi des milliers d’autres. Le tout en un battement de cils.

Il existe deux usages distincts. Le premier, l’authentification, tend à vérifier l’identité d’un individu. Présent dans trois aéroports de la région Île-de-France, le système Parafe (2) est un exemple. Devant un portique, une caméra compare le visage du voyageur à sa photo stockée dans la puce de son passeport biométrique pour lui autoriser le passage. L’autre usage, l’identification dite « à la volée », peut fonctionner en temps réel avec les images fournies par des caméras de vidéosurveillance. Une personne marche dans la rue et un logiciel de reconnaissance faciale va comparer son visage à une base de données alimentée par des profils, ceux d’individus recherchés par exemple. Policiers comme gendarmes louchent sur cet usage. Le Graal de l’enquêteur et la boîte de Pandore pour tout défenseur des libertés, tant cette utilisation ouvre la voie à une surveillance généralisée. À propos de cet usage, Cédric O admet à demi-mot vouloir l’inclure dans l’expérimentation.

Jeux olympiques de 2024

Des discours moins policés s’entendent à l’événement mondial de la sécurité intérieure des États : le salon Milipol, qui se déroulait du 19 au 22 novembre au nord de Paris. Dans les allées du parc des expositions de Villepinte, cravates, treillis et uniformes des quatre coins du monde se croisent. Ici, un œil se jette dans la lunette d’un fusil de précision. Là, un grand écran rejoue en boucle les scènes d’émeutes parisiennes d’il y a un an, mais revisitées. Un rectangle cible et traque chaque gilet jaune. Plus loin, les conférences s’enchaînent. Aucune ne traite spécifiquement de la reconnaissance faciale, mais le sujet revient régulièrement sur la table, surtout pour enfoncer les législations française et européenne. Un ardent défenseur de cette technologie illustre l’inévitable. « La question n’est pas de savoir si nous y allons ou pas. La question, c’est : comment allons-nous y aller ? » affirme, déterminé, Dominique Legrand, président de l’Association nationale de la vidéoprotection (AN2V).

« Sur la reconnaissance faciale, il y a un blocage », regrette à son tour Gérard Lacroix, regard franc mais fermé. Le visage dur du membre du Gicat (3) se détend : « Une porte s’ouvre avec le livre blanc sur la sécurité intérieure. » En cours de rédaction, ce document, piloté par le ministère de l’Intérieur, a l’ambition de poser un diagnostic sur les nouvelles menaces et d’y adjoindre les solutions novatrices. Parmi les quatre groupes de travail chargés de son élaboration, le dernier s’intéresse aux technologies liées à l’intelligence artificielle. « Toutes les technologies, pas seulement la reconnaissance faciale », relativise une source proche du ministère. Le livre blanc servira de support pour de futurs textes sécuritaires.

Rencontré plusieurs jours après le salon Milipol, Gérard Lacroix n’a pas perdu de sa franchise. « Les industriels piaffent d’impatience. Il y a un décalage entre un développement technologique très rapide et un rythme législatif très lent. Il manque une loi pour se lancer en France », commente le directeur général adjoint du Gicat. L’homme donne le cap : « Nous devons être prêts pour les Jeux olympiques de 2024. » Un souhait compris dans le contrat de filière sécurité, accord passé entre l’État et les entreprises du secteur. Marc Darmon, directeur général adjoint de Thales – l’un des groupes français les mieux positionnés mondialement sur la reconnaissance faciale –, pilote le comité stratégique de filière. La sécurisation des Jeux de Paris constitue en effet l’un des gros chantiers de l’accord, confie le directeur dans une interview accordée à AEF info (4), dans l’espoir d’en faire « une vraie vitrine de l’industrie française ». Mais le ton se veut rassurant, les solutions prévues de reconnaissance faciale « doivent permettre de suivre les flux, repérer des profils, dans un souci d’optimiser les opérations plutôt que dans un souci de flicage ». Nous voilà rassurés. En cours de signature, le contrat entraîne des obligations réciproques. Le gouvernement peut notamment faire des promesses d’évolutions législatives et réglementaires.

« Si les industriels mettent la pression pour produire une loi d’expérimentation – et donc une loi d’exception –, c’est pour se rassurer à l’égard du potentiel obstacle que peut constituer la Commission nationale de l’informatique et des libertés (Cnil) », analyse Martin Drago, juriste à la Quadrature du Net, association de défense des libertés fondamentales et farouchement opposée à la reconnaissance faciale (lire page 24). Une exception à quelle règle ? Depuis 2018, le règlement général sur la protection des données (RGPD) s’applique dans toute l’Union européenne. En vertu de l’article 9 de ce texte, le visage constitue une donnée sensible, car il peut identifier quelqu’un de manière unique. En principe, le RGPD proscrit tout traitement de ces données, mais prévoit quelques exceptions. Dans ce cas, les ordonnateurs d’un tel traitement doivent réaliser une étude d’impact pour prouver à la Cnil la conformité au règlement.

À ce titre, l’expérimentation avortée de portiques d’authentification de deux lycées à Nice et à Marseille fait figure de cas d’école. La région Paca voulait pendant une année conditionner l’entrée des élèves à la reconnaissance de leur visage – calqué sur le système Parafe des aéroports. Ce traitement se fondait sur le consentement éclairé des lycéens, l’une des exceptions prévues par le règlement européen. Mais le consentement ne suffit pas. En octobre, la Cnil a déclaré illégale cette expérimentation car elle ne respectait pas le principe de proportionnalité et de minimisation des données. Les objectifs affichés – sécuriser et fluidifier les entrées des établissements – pouvaient être atteints par des moyens moins intrusifs, comme la détention d’un simple badge. Pour l’instant, la Cnil n’a été saisie que d’une dizaine d’expérimentations, selon Thomas Dautieu, directeur de la conformité à la Cnil.

Millions de visages

D’autres dépassent le stade de la simple expérimentation. Le ministère de l’Intérieur n’a pas attendu la tenue d’un débat démocratique pour avoir recours à la reconnaissance faciale. Le fichier de traitement des antécédents judiciaires (TAJ), fichier interne à la police et à la gendarmerie, anticipait l’usage de cette technologie dès sa mise en place en 2012. Son décret d’application prévoit noir sur blanc de regrouper toute « photographie comportant des caractéristiques techniques permettant de recourir à un dispositif de reconnaissance faciale (photographie du visage de face) ». S’y retrouvent pêle-mêle des clichés de condamnés ou de personnes suspectées d’avoir participé à une infraction et contre lesquelles il existe des indices « graves ou concordants ». Selon un rapport parlementaire de l’année dernière, le fichier contiendrait entre 7 et 8 millions de visages.

Dans le cadre d’une enquête judiciaire, policiers ou gendarmes peuvent verser dans le fichier TAJ des photos réalisées en garde à vue ; des captures d’écran de caméras de vidéosurveillance ; ou encore des photos glanées sur les réseaux sociaux. Cas pratique : les forces de l’ordre détiennent une photo d’un manifestant recherché prise par un agent de terrain. Le logiciel FaceVACS-DBScan(5), fourni par la compagnie allemande Cognitec Systems, compare l’image avec les millions d’autres du fichier et va faire ressortir des fiches, si ressemblance il y a. « Nous avons déjà fait des tas de contrôles sur le TAJ, pas encore à propos de la reconnaissance faciale, mais nous nous y intéressons de près », assure Thomas Dautieu, de la Cnil.

Les membres de la Quadrature du Net ne veulent pas attendre. L’association a demandé au gouvernement l’abrogation du décret. En cas de refus, ils attaqueront cette décision devant le Conseil d’État. Selon eux, une autre loi européenne s’applique au fichier. La directive police-justice de 2016 complète le RGPD et encadre les traitements de données effectuées par les forces de l’ordre. L’article 10 autorise le traitement de données sensibles uniquement en cas de « nécessité absolue ». « Les usages de la reconnaissance faciale sécuritaire n’ont qu’une finalité : faire ce que la police fait déjà mais plus facilement », assène Arthur Messaud, juriste à la Quadrature, avant de poursuivre : « Faciliter n’a jamais été un motif de nécessité absolue. » Reste à savoir comment les juges définiront cette notion sujette à interprétation, et si un magistrat se sentira le courage de priver la police d’un de ses outils préférés.

« À la française »

Pour l’instant, les contours de l’expérimentation de Cédric O paraissent obscurs, peu détaillés. Didier Baichère, lui, sait où il veut aller. Vice-président de l’Office parlementaire d’évaluation des choix scientifiques et techniques (OPECST), le député de La République en marche a rendu une note sur la reconnaissance faciale en juillet. Il y définit la nécessité d’offrir un cadre de régulation, une « voie à la française », selon ses propres termes. « Il faut s’assurer du caractère et de la méthode scientifiques de cette expérimentation, sous le regard d’un collège d’experts », insiste le parlementaire. Une parade pour respecter le RGPD. Le règlement européen autorise le traitement de données sensibles à des fins de recherches scientifiques. En revanche, l’expérimentation devra se borner à cette seule finalité. L’élu des Yvelines a déjà un calendrier en tête. « Il faut la borner dans le temps et dans l’espace, trois années me semblent une durée sérieuse, et dans un nombre défini de régions », expose-t-il avant de continuer : « Si la loi d’expérimentation est votée cette année, disons en septembre, nous pourrions tester la reconnaissance faciale pour nous tenir prêts à sécuriser le Mondial de rugby en 2023, puis peaufiner nos dispositifs pour les Jeux olympiques de 2024. » Une aubaine pour les industriels français.

Et la menace d’un effet cliquet. Comment imaginer un retour en arrière une fois la reconnaissance faciale bien installée, même à titre de simple expérience ? Et de quelles garanties dispose le citoyen face à de possibles détournements d’usage ? Le salon Milipol donnait un aperçu d’un affranchissement successif des limites. La société Idemia – autre poids lourd français de la reconnaissance faciale – présentait un retour d’expérience du G20 de Buenos Aires de 2018. Leur dispositif de sécurisation de l’événement comprenait une « zone rouge », un périmètre ultra-sécurisé où se déroulaient les rencontres entre chefs d’État. Les caméras de cette zone se couplaient à de la reconnaissance faciale. Le système s’adossait à une base de données rassemblant 13 000 potentiels fauteurs de troubles, alimentée par la police locale et des organisations internationales, dont Interpol.

Albert Tabet, vice-président d’Idemia pour le maintien de l’ordre et l’analyse de données vidéo, voit plus loin : « Il faut dépasser la simple détection de la menace, les forces de l’ordre nous l’ont bien fait comprendre : il faut empêcher avant le passage à l’acte. » Un ex-policier chef d’état-major du Raid (6), désormais consultant pour Idemia, abonde : « Les menaces ne se manifestent pas au cœur de ce genre d’événement, mais à leur périphérie. Il faut élargir le dispositif, sortir de la zone rouge. » Franchir une barrière amène à en franchir d’autres.

(1) Ou « apprentissage profond ». Méthode d’entraînement automatisé d’une machine, d’un algorithme.

(2) Passage automatisé rapide aux frontières extérieures, fourni par le groupe Thales.

(3) Groupement des industries de défense et de sécurité terrestres et aéroterrestres.

(4) Agence éducation et formation, agence d’informations spécialisées, notamment dans la sécurité globale.

(5) Solution de reconnaissance faciale utilisée par les forces de l’ordre, selon le magazine L’Essor, mensuel de la gendarmerie.

(6) Recherche, assistance, intervention, dissuasion.

Pour aller plus loin…

« Il existe une banalisation des pratiques non conventionnelles de soin »

« Avant, 70 % des travailleurs géraient la Sécu. Aujourd’hui, c’est Bayrou. Voilà le problème »

L’atelier Missor dans le moule du combat civilisationnel